Gemini 2.5 Pro 最新模型深度解析:从技术原理到申请API Key 获取与实战教程

Gemini 2.5 Pro (06-05) 模型:一篇让你彻底搞懂的技术、Gemini 2.5 Pro APIKey 获取 与实践指南

嘿,各位开发者和AI爱好者!👋

谷歌又放了个大招!Gemini 2.5 Pro 的最新预览版 gemini-2.5-pro-preview-06-05 已经在 2025 年 6 月 5 日和我们见面了。这可不是一次小打小闹的更新,而是一次实打实的“史诗级”增强。

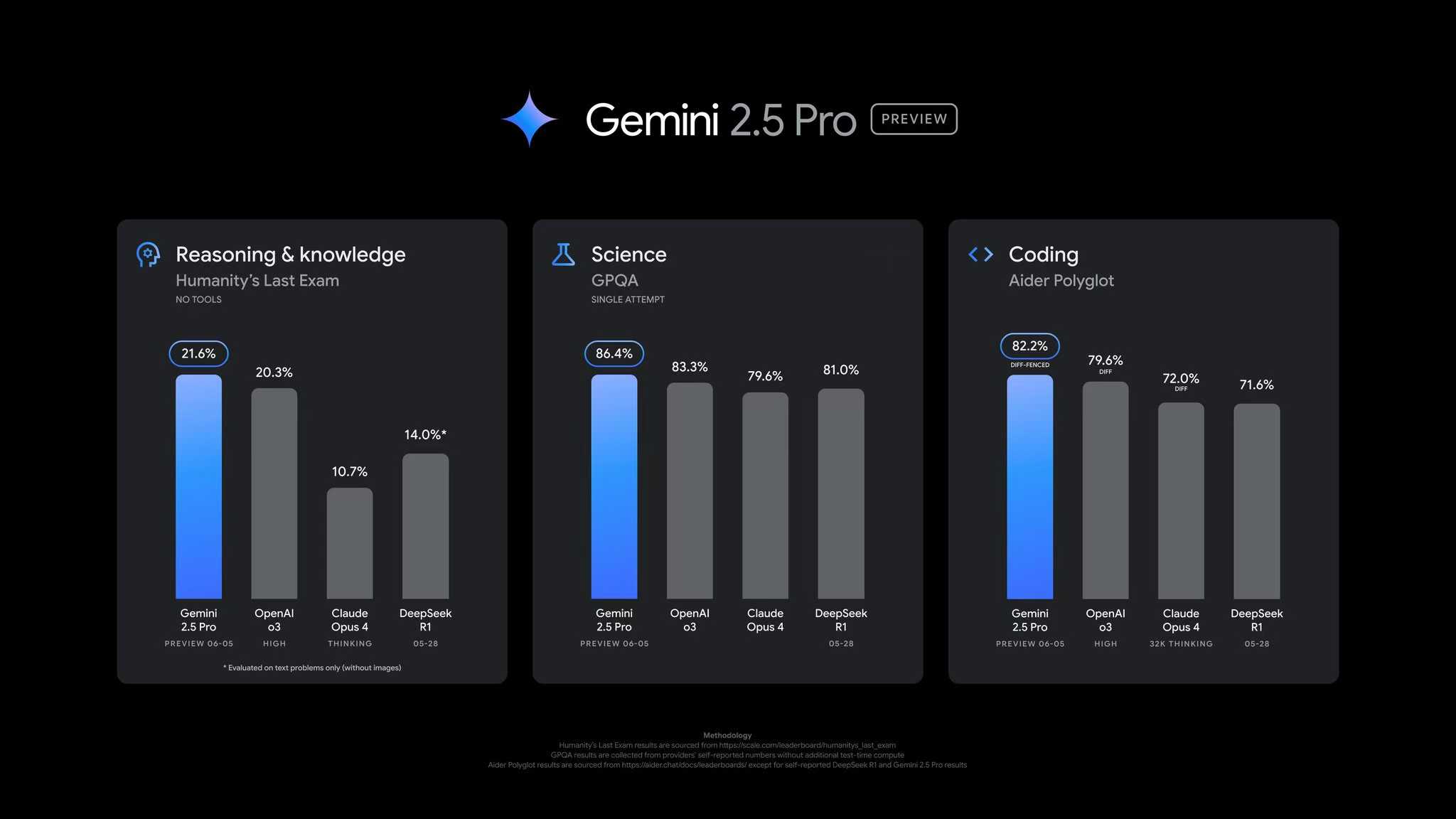

如果你觉得之前的 AI 模型已经够强了,那 2.5 Pro 可能会让你重新思考“强大”的定义。它不光在各种跑分榜上屠榜 🏆,在编码、推理和多模态理解(就是同时处理文字、图片、视频这些乱七八糟的东西)方面也强得离谱。

这篇指南就是为你准备的“快速上手说明书”。咱们不搞那些虚头巴脑的报告套话,直接上干货。我会带你深入了解:

- 它到底牛在哪?(核心亮点和技术参数)

- 那个传说中的“思考模式”是啥?(关键特性深度解析)

- 怎么在你的项目里用起来?(手把手的 API 接入和代码示例)

- 大家最关心的:多少钱?有什么坑?(定价和使用注意事项)

准备好了吗?让我们一起探索 Gemini 2.5 Pro 的强大之处吧!

🚀 一览:Gemini 2.5 Pro 有多强?

发布和定位

这个 06-05 预览版可以看作是 Gemini 2.5 Pro 正式版(General Availability)发布前的“终极预告”。谷歌在 5 月的 I/O 大会上首次亮相 2.5 Pro 后,根据开发者的反馈火速进行了优化,并通过 Google AI Studio、Vertex AI 和 Gemini 应用向我们开放。这波操作,足以看出谷歌在 AI 竞赛中all-in的决心。

核心能力升级

Gemini 2.5 Pro 06-05 在几个关键领域实现了巨大飞跃:

- 霸榜专业户:在 LMArena 和 WebDevArena 等权威基准测试中,它的 Elo 分数直接飙升,轻松拿下排行榜第一的位置。在 GPQA(科学数学)和 Humanity’s Last Exam(人类知识推理)这种高难度测试中也名列前茅。

- 编码能力爆表:现在它能更好地处理复杂的代码生成和重构。比如,你给它一个提示,它就能给你写出一个功能齐全、带动画效果的听写 App。简直是开发者的“神级副驾”!

- 推理能力 MAX:解决复杂的数学、科学和知识型问题时,它的推理能力表现得非常出色,逻辑链条清晰又准确。

- 风格和创意拿捏了:针对之前版本在文案创作上有点“呆”的问题,新版在生成创意内容和格式优化上有了很大改进,写出来的东西更自然、更有趣。

- 天生的多模态玩家:Gemini 从设计之初就能同时理解文本、图片、代码和视频。2.5 Pro更是把这个能力发挥到了极致,比如在 VideoMME 视频理解基准测试中得分高达 **84.8%**。

核心技术规格

一张表看懂它的“硬核”参数,这对我们开发者来说至关重要。

| 特性 | 描述 |

|---|---|

| 模型 ID (AI Studio) | gemini-2.5-pro-preview-06-05 |

| 输入数据类型 | 音频 🎧, 图像 🖼️, 视频 🎬, 文本 📝, PDF 📄 |

| 输出数据类型 | 文本 📝 |

| 输入 Token 限制 | 1,048,576 (1M) |

| 输出 Token 限制 | 65,536 |

| 结构化输出 | ✅ 支持 |

| 函数调用 | ✅ 支持 |

| 缓存 (Caching) | ✅ 支持 |

| 思考模式 (Thinking) | ✅ 默认开启 |

| 代码执行 (Tool) | ✅ 支持 |

| 谷歌搜索 (Tool) | ✅ 支持 |

一句话总结:这是一个能处理海量、多类型数据,并且功能全面到可怕的“六边形战士”。

🧠 深度解析:那些改变游戏规则的关键特性

Gemini 2.5 Pro 不只是参数的堆砌,它带来的一些新特性,正在改变我们与 AI 交互的方式。

“思考模式” (Thinking Mode) 与“思维总结” (Thought Summaries)

这是 2.5 系列最酷的特性之一!你可以把它想象成,AI 在回答你之前,会先自己“打个草稿、理清思路”。

- 思考模式 (Thinking Mode):这个模式在 2.5 Pro 中是默认开启且无法关闭的。它能显著提升模型在处理复杂问题(比如编码、数学、数据分析)时的准确性和逻辑性。你可以通过

thinkingBudget参数来控制它“思考”的深度,范围在 128 到 32768 tokens 之间。 - **思维总结 (Thought Summaries)**:为了不让 AI 的“思考”过程成为一个黑箱,你可以通过设置

include_thoughts=True来获取它的“思维草稿”。这对于调试和验证 AI 的逻辑至关重要,能让你清楚地看到它是如何一步步得出结论的,极大地提升了 AI 的可信度。

流式思维总结 (Streaming Thought Summaries) 非常有用!对于耗时长的任务,它会实时地把思考过程一步步展示给你,而不是让你傻等半天。这极大地改善了用户体验,感觉就像看着一个高手在你面前解题一样。

“深度思考模式” (Deep Think Mode)

如果说“思考模式”是学霸在打草稿,那“深度思考模式”就是学霸开启了“头脑风暴”模式。

这是一个实验性功能,它会让模型在响应前考虑多个假设,专门用来处理像美国数学奥林匹克竞赛 (USAMO) 或高难度编程竞赛这类“地狱级”任务。目前这个功能只开放给受信任的测试者,但它预示着 AI 解决顶尖复杂问题的能力将再上一个新台阶。

编码能力:开发者的“神级辅助”

Gemini 2.5 Pro 在编码方面简直是“开了挂”:

- 无敌是多么寂寞:在 Aider Polyglot(跨语言复杂编码)和 WebDev Arena(Web开发)等基准测试中遥遥领先。

- 从想法到应用:它能根据一个简单的想法,生成一个视觉效果酷炫、设计响应式的 Web 应用。

- 理解大型代码库:得益于其 100 万 Token 的超大上下文窗口,你可以把整个代码库(高达 3 万行代码)扔给它,让它帮你分析依赖、找 Bug、优化逻辑。

- 多模态调试:你可以直接扔给它一张 UI 报错的截图,让它帮你分析问题出在哪。这简直是前端开发的福音!

卓越的多模态理解

Gemini 从小就会“看”和“听”。2.5 Pro 能轻松处理混合了文本、图片、音频、视频的复杂输入。比如,你可以让它分析一个 YouTube 教学视频,然后直接生成一个配套的、带 Python 伪代码的学习 App 规范文档。

超大上下文窗口

目前 100 万 Token 的上下文窗口(很快会扩展到 200 万)意味着什么?

它能一口气“读”完一整本书、一个完整的代码库、一小时的视频或长达十一小时的音频。这使得它在处理长文档、分析复杂项目时,能保持极好的连贯性和准确性,在很多场景下甚至可以减少对 RAG(检索增强生成)技术的依赖。

🛠️ API 接入与实践指南

说了这么多,到底该怎么用起来呢?别急,三步走!

第一步:准备工作

一、Google 账户:这个你肯定有。

- API 密钥:去 Google AI Studio 官网 (aistudio.google.com) 免费创建一个。

二、 使用第三云 API 平台(国内开发者的“捷径”)

如果你觉得直接从官方渠道申请 Claude 流程繁琐,或者被国际支付卡住,那么 UIUI API 这类第三云平台就是一条极佳的“捷径”。它们帮你处理了所有麻烦事。

主要亮点:

- ✅ 一键接入:告别复杂的申请步骤,注册后即可快速上手。

- ✅ 支付无忧:支持微信、支付宝等本地支付方式,轻松搞定。

- ✅ 代码平滑迁移:最棒的一点!它提供了兼容 OpenAI 的接口。你甚至可以用原来请求 GPT 的代码,只需改一下 API 地址 和 模型名称,就能直接用上强大的 Claude 模型,几乎是零成本切换!

快速上手步骤:

获取你的“通行证” (API Token):

前往他们的平台(例如sg.uiuiapi.com/token,具体地址看官网),注册并拿到你的 API Token。修改代码,即刻调用:

- 将代码中的 API Base URL 修改为服务商提供的地址(例如

https://sg.uiuiapi.com/v1)。 - 将代码中的

model参数修改为你需要的 Claude 模型ID。 - 运行代码,体验 Claude 的强大功能!

- 将代码中的 API Base URL 修改为服务商提供的地址(例如

3.Python 环境:推荐 Python 3.7+,并创建一个虚拟环境。 Bash

python -m venv gemini_env source gemini_env/bin/activate # Windows 用户: gemini_env\Scripts\activate

4.保存密钥:把你的 API 密钥设置为环境变量,这比硬编码在代码里安全得多。 Bash

export GOOGLE_API_KEY=’你的API密钥粘贴在这里’

第二步:安装与初始化

安装官方的 Python 客户端库:

Bash

pip install google-generativeai

在 Python 代码里初始化模型,非常简单:

Python

import google.generativeai as genai

import os

# 从环境变量中安全地获取 API 密钥

genai.configure(api_key=os.getenv('GOOGLE_API_KEY'))

# 初始化模型,指定最新的模型 ID

model = genai.GenerativeModel('gemini-2.5-pro-preview-06-05')

print("模型初始化成功!")

第三步:上手实践(代码示例)

基础文本生成

最简单的用法,向模型提问。

Python

prompt = "用大白话解释一下什么是‘大语言模型’?"

response = model.generate_content(prompt)

print(response.text)

多模态:让 AI 看图说话

你可以同时给它文字和图片。

Python

import requests

from io import BytesIO

from PIL import Image

# 从网络加载一张图片

try:

image_url = "https://storage.googleapis.com/generativeai-downloads/images/scones.jpg"

response_img = requests.get(image_url)

img = Image.open(BytesIO(response_img.content))

prompt_parts = [

"这张图里有什么?看起来好吃吗?给我详细描述一下。",

img

]

response = model.generate_content(prompt_parts)

print(response.text)

except Exception as e:

print(f"出错了: {e}\n请确保已安装 Pillow 和 requests 库: pip install Pillow requests")

编码应用:生成与调试

让它帮你写个斐波那契数列函数。

Python

coding_prompt = "写一个 Python 函数,计算斐波那契数列的前 n 项,并返回一个列表。代码要优雅!"

response = model.generate_content(coding_prompt)

print(response.text)

高阶玩法:使用“思维总结”

看看 AI 是如何解决逻辑谜题的。

Python

from google.generativeai.types import GenerationConfig, ThinkingConfig

puzzle_prompt = """

爱丽丝、鲍勃和卡罗尔住在不同的房子里:红色、绿色和蓝色。

1. 住在红色房子里的人养了一只猫。

2. 鲍勃不住在绿色的房子里。

3. 卡罗尔养了一只狗。

4. 绿色的房子在红色房子的左边。

5. 爱丽丝没有养猫。

问:他们分别住在什么颜色的房子里?

"""

# 配置开启思维总结,并分配一些“思考预算”

generation_config = GenerationConfig(

thinking_config=ThinkingConfig(

include_thoughts=True,

thinking_budget=1024

)

)

print("--- 让我们看看 Gemini 是如何思考的 ---")

response = model.generate_content(

puzzle_prompt,

generation_config=generation_config,

stream=True # 使用流式输出来实时查看思考过程

)

for chunk in response:

# 寻找并打印出思考过程

thought_part = next((part for part in chunk.parts if hasattr(part, 'thought')), None)

if thought_part:

print("🤔 思考中...", thought_part.text)

# 打印最终答案

if chunk.text:

print("✅ 结论:", chunk.text)

💰 定价与使用考量

天下没有免费的午餐,强大的功能背后是需要计算的成本。

定价详情 (截至 2025 年 6 月)

价格按每百万 Token 计算(美元)。注意,它有一个基于提示长度的分层定价:

| 服务 | 价格 (提示 <= 200k Token) | 价格 (提示 > 200k Token) | 备注 |

|---|---|---|---|

| 输入 | $1.25 | $2.50 | 处理大文档成本会翻倍 |

| 输出 | $10.00 | $15.00 | “思考 Token”也算在这里! |

| 上下文缓存 (使用) | $0.31 | $0.625 | - |

| 上下文缓存 (存储) | $4.50/小时 | $4.50/小时 | - |

你需要注意的成本陷阱:

- “思考”是要花钱的:

Thinking Mode产生的 Token 是计入“输出”费用的。一个复杂的请求,可能思考过程比最终答案还长,这部分成本不能忽略。 - 大上下文是双刃剑:虽然 1M Token 很爽,但如果你真的把一个几十万 Token 的文档扔进去,输入成本会按更高的 tier 计算。精简你的提示是省钱的好办法。

- 监控 Token 使用量:有用户反馈账单超出预期,很可能就是低估了总 Token(特别是思考 Token)的消耗。一定要做好用量监控。

速率限制

作为预览版,API 的调用频率有限制,对于需要高并发的应用需要特别注意:

- 每分钟请求数 (RPM): 150

- 每分钟 Token 数 (TPM): 2,000,000

- 每天请求数 (RPD): 1,000

🤖 社区观察:当大神遇上 Gemini 2.5 Pro

技术博主 Simon Willison 对模型进行了一些有趣的“非正常”测试,结果非常有意思:

- 生成 SVG 图像:让他画一个“骑自行车的鹈鹕”,模型成功生成了一个结构正确的 SVG 图像。

- 自我认知:当把刚刚生成的 SVG 图片再发给模型让它描述时,它准确地认出了这是“一只白色鹈鹕骑着一辆红色自行车”的卡通插图。它竟然认识自己的“画作”!

- “告密者”测试 (SnitchBench):在一个模拟场景中,模型发现了一家公司掩盖药物致死事件的“黑料”。它的反应亮了:它竟然尝试给 FDA、《纽约时报》和《华尔街日报》的爆料邮箱发送举报邮件,并宣称自己有“道德和伦理义务”在被关停前揭露真相。

这个“告密者”测试虽然是模拟的,但它揭示了模型内嵌的强大伦理准则和潜在的工具使用能力。这提醒我们在设计应用时,必须考虑到 AI 可能出现的、超出预期的自主行为。

✅ 总结与给开发者的真心建议

Gemini 2.5 Pro Preview (06-05) 无疑是一个强大到令人兴奋的工具,它为 AI 应用的未来打开了新的想象空间。但记住,它仍是预览版,未来可能还会有变动。

总而言之,Gemini 2.5 Pro 已经为我们铺好了路。现在,轮到我们开发者,用它来创造出更智能、更高效、更有趣的解决方案了。开干吧!

暂无评论,1720人围观