OpenAI 发布新版GPT-4o绘画模型API:GPT-image-1 API KEY获取与代码示例详解

OpenAI 近期宣布正式发布其最新的图像生成 API,模型标识为 gpt-image-1。此举标志着一个重要的里程碑,将先前在 ChatGPT 中展示并广受欢迎、由 GPT-4o 模型驱动的先进图像生成能力,首次以编程方式提供给全球的开发者和企业 。这一发布被视为人工智能领域,特别是多模态 AI 应用发展中的关键一步,它使得将高保真、高灵活性的图像生成功能直接集成到各种工具、平台和应用程序中成为可能 。

gpt-image-1 所基于的技术在 ChatGPT 产品中已经证明了其强大的吸引力。据 OpenAI 披露,在该功能上线的第一周内,用户就生成了超过 7 亿张图片,吸引了数百万新用户,这充分显示了市场对此类先进图像生成能力的巨大需求和潜力 。

本报告旨在基于 OpenAI 官方公告、技术文档、合作伙伴集成案例以及初步的社区反馈(均来源于提供的研究材料),对 gpt-image-1 API 进行一次全面、深入的分析。报告将详细探讨其技术特性、核心功能、与先前模型的差异、开发者接入方式、潜在应用场景、安全措施以及其市场意义与未来展望,为关注 AI 图像生成领域的技术专家、开发者和决策者提供一份有价值的参考。

2. 揭秘 gpt-image-1:新 API 详解

此次 OpenAI 推出的 API,其核心图像生成模型的官方名称确认为 gpt-image-1 。该模型与备受瞩目的 GPT-4o 模型家族紧密相关,它所利用的正是驱动 ChatGPT 中 GPT-4o 图像生成功能的底层技术 。这意味着开发者现在可以通过 API 调用,获得与 ChatGPT 产品中相媲美的图像生成体验。

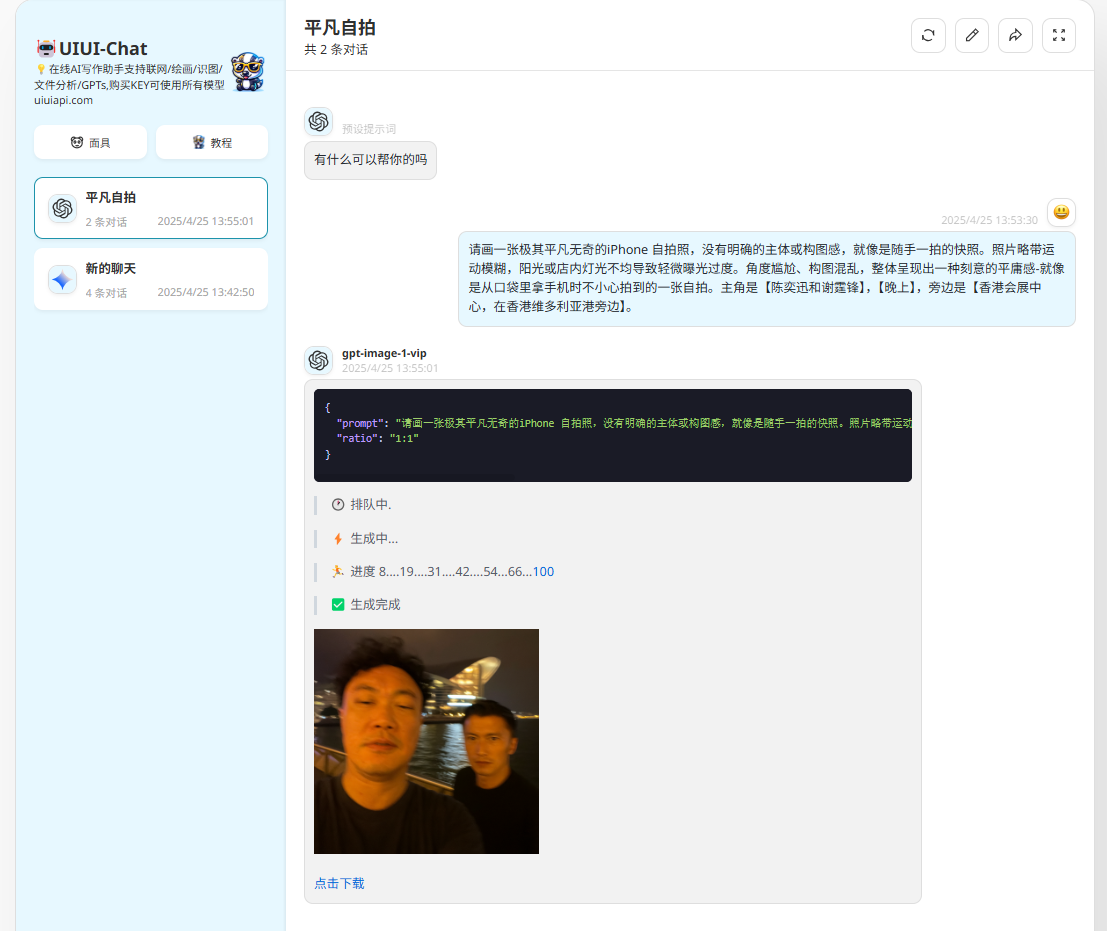

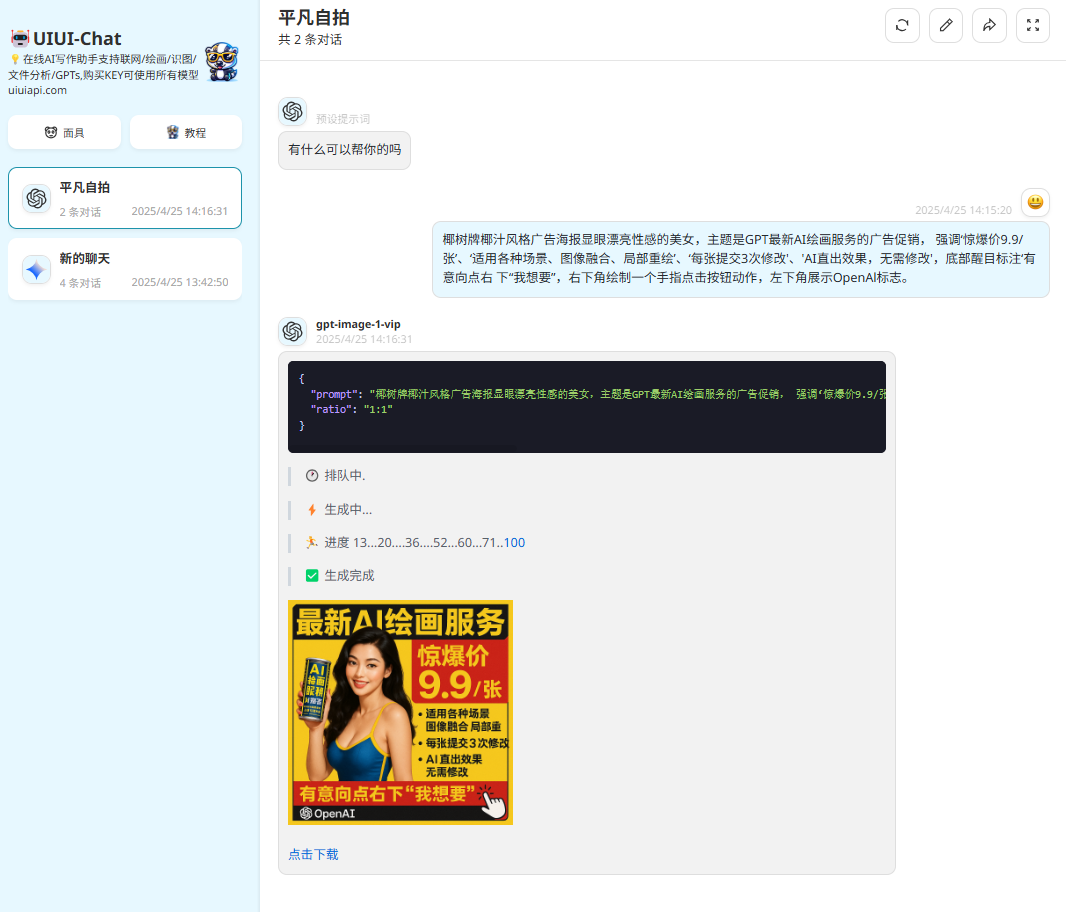

以下是在uiuiapi 获取的gpt-image-1 api key调用使用案列;

gpt-image-1 的核心架构被定义为一个“原生多模态大型语言模型” (natively multimodal large language model) 。这种架构设计本身就构成了其与 OpenAI 先前如 DALL·E 系列等专门图像生成模型的根本区别。DALL·E 模型是为图像生成这一特定任务而构建的,而 gpt-image-1 则是将视觉理解和生成能力深度嵌入到一个更广泛的语言模型框架之内 。这种“原生”集成并非简单地将文本和图像处理模块拼接,而是意味着模型在一个统一的架构内处理和理解多模态信息。这种设计使得 gpt-image-1 能够更有效地利用其庞大的世界知识库和对视觉信息的深刻理解来进行图像创作 。其优势在于能够更好地理解融合了文本和视觉元素的复杂指令,生成在语义和视觉上都更连贯、更符合上下文的输出。例如,当被要求生成一个包含最受欢迎半宝石的玻璃柜时,gpt-image-1 能够利用其内置知识,无需外部参考就能准确选择紫水晶、玫瑰石英、玉石等宝石,并以逼真的方式呈现出来 。

3. 核心功能与技术规格

gpt-image-1 API 展现了一系列强大的核心功能和明确的技术规格,旨在满足开发者对高质量、高控制度图像生成的需求。

高保真生成与风格多样性: 该模型能够生成细节丰富、画面连贯、视觉效果引人注目的高保真图像,包括达到照片级真实感的效果 。其强大的风格适应能力允许开发者通过在提示词中描述期望的美学风格(如油画、水彩、像素艺术、3D 渲染、极简线条画等),生成多样化的视觉输出 。

指令遵循与细节控制: 相较于 OpenAI 之前的模型,

gpt-image-1在遵循用户指令方面表现出显著的优越性 。它能更好地理解和执行包含多个对象(GPT-4o 被提及可处理 10-20 个对象,而其他系统可能在 5-8 个对象时遇到困难)和复杂细节要求的提示词 。这种能力的提升,特别是对物体数量处理能力的增强以及从用户上传图像中学习并融入生成过程(上下文学习)的能力 ,直接解决了以往图像生成模型在处理复杂场景、精确控制和个性化定制方面的常见痛点,显著提高了模型在要求更高的创意和设计任务中的实用性。文本渲染能力:

gpt-image-1在图像中准确渲染清晰易读且符合上下文语境的文本方面取得了重大突破 。这克服了以往图像生成模型普遍存在的短板,使得图像作为视觉传达工具的能力得到极大增强。多个示例展示了其在海报、邀请函、图示说明等场景中生成高质量嵌入文本的能力 。尽管进步显著,但仍需注意,在极端复杂的布局或字体要求下,模型在文本的精确放置和绝对清晰度方面有时仍可能面临挑战 。世界知识整合: 作为原生多模态模型的一部分,

gpt-image-1能够调用其底层语言模型的广泛世界知识,生成包含符合现实逻辑和常识性细节的图像 。技术规格 (API 参数): 开发者可通过 API 参数精细控制生成过程 。关键参数包括:

model: 指定使用"gpt-image-1"模型。prompt: 必需参数,描述所需图像的文本字符串。n: 可选,生成图像的数量,默认为 1。size: 可选,图像尺寸。支持"1024x1024"(方形),"1536x1024"(竖向),"1024x1536"(横向)。另有一个"auto"选项(默认),模型会根据提示词自动选择最佳尺寸 。需要注意的是,虽然其他文档中提及过不同尺寸 ,但 提供的尺寸规格似乎是针对gpt-image-1API 最明确的说明。quality: 可选,渲染质量。选项包括"low","medium","high", 以及"auto"(默认) 。format: 可选,输出文件格式。支持"png"(默认),"jpeg","webp"。output_compression: 可选,当format为"jpeg"或"webp"时可用,控制压缩级别(0-100%)。background: 可选,设置透明背景。仅支持"png"和"webp"格式,建议在quality为"medium"或"high"时使用。设为"transparent"启用 。moderation: 可选,控制内容审核过滤器的严格程度。支持"auto"(默认) 和"low"或"strict"。(注意:关于非默认选项的描述在不同来源中存在细微差异, 提及 “low”,而 / 提及 “strict”,开发者应参考最新的官方文档或进行测试以确认确切可用值。)这些参数中,

output_compression和background(透明度) 的加入,直接满足了平面设计和网页开发等实际工作流程中的常见需求 。例如,能够直接生成带透明背景的 PNG 或压缩优化的 WebP 图像,简化了以往需要额外后期处理的步骤,使得 API 更适用于生产环境中的素材生成。

输入要求 (图像输入): 当使用图像作为输入(例如在编辑功能中)时,支持的格式包括 PNG, JPEG, WEBP, 以及非动画 GIF 。单个图像文件大小限制为 20MB 。文档中还提及了与视觉输入相关的分辨率限制(低分辨率 512x512,高分辨率短边 768px 长边 2000px),虽然其上下文似乎更偏向于图像分析(vision),但开发者在使用图像作为生成或编辑的输入时也应留意这些潜在的尺寸考量。

4. 高级编辑与多模态交互

gpt-image-1 不仅仅是一个从零开始生成图像的工具,它还提供了强大的图像编辑和多模态交互能力,进一步拓展了其应用范围。

编辑能力: API 提供了专门的

/images/edits端点,用于对现有图像进行修改 。主要编辑方式包括:图像修复 (Inpainting): 允许开发者精确修改图像的特定区域。这需要提供原始图像 (

image参数) 以及一个“蒙版”图像 (mask参数)。蒙版是一个与原图尺寸相同、包含透明通道的 PNG 文件,其透明区域指示了需要根据prompt描述进行修改的部分,而不透明区域则保持不变 。图像到图像生成 / 基于参考图的生成: 开发者可以提供一张或多张现有图像作为参考 (

image参数),结合文本提示 (prompt) 来指导新图像的生成,或对参考图应用风格变换、添加元素等 。一个具体的例子是使用多张单独的产品照片作为输入,生成一张包含这些产品的礼品套装组合图 。多轮优化 (上下文编辑): GPT-4o 模型本身支持在对话中通过自然语言逐步优化图像 。这意味着用户可以基于先前生成的图像进行迭代修改。虽然当前的

/images/editsAPI 端点可能更侧重于单次编辑请求,但这种上下文感知、多轮交互的底层能力是存在的。OpenAI 已明确计划将图像生成/编辑功能整合到其Responses API中(目前状态为“即将推出”)。这一整合预示着未来可以通过 API 实现更流畅的、基于对话状态的图像创作流程。这种预期与一些分析观点不谋而合,即 GPT-4o 级别的多模态 API 将推动用户界面从简单的“提示-生成”模式转向更具对话性的交互模式,支持图像输入、上下文保持和动态编辑,使图像生成更像是一场持续的创作对话,而非一次性的命令执行 。这预示着 API 的潜力不仅在于生成静态图像,更在于赋能新型的交互式创意工作流。

多模态输入处理: 编辑端点能够同时接受文本 (

prompt) 和图像 (image) 输入,实现真正的多模态操作 。模型能够分析用户上传的图像,并将其作为视觉灵感来源或将其中的细节特征整合到生成结果中(即“上下文学习”能力)。角色一致性: 尽管

gpt-image-1在生成连贯图像方面有显著改进,但在跨多张图像、多次生成请求中保持角色(例如漫画人物、品牌吉祥物)或特定视觉元素的绝对一致性,仍然是一个挑战 。用户实验表明,即使基于之前的生成结果进行后续创作,新生成的角色也可能在细节或风格上与原始角色存在差异 。OpenAI 自身也承认模型可能在维持重复出现的角色或品牌元素的视觉一致性方面遇到困难 。这表明,虽然整体连贯性和指令遵循能力得到提升,但对于需要高度视觉身份连续性的应用(如系列漫画、游戏资产、品牌视觉系统),开发者仍需采取精心的提示策略或进行迭代优化,不能完全依赖模型自动保持完美一致。

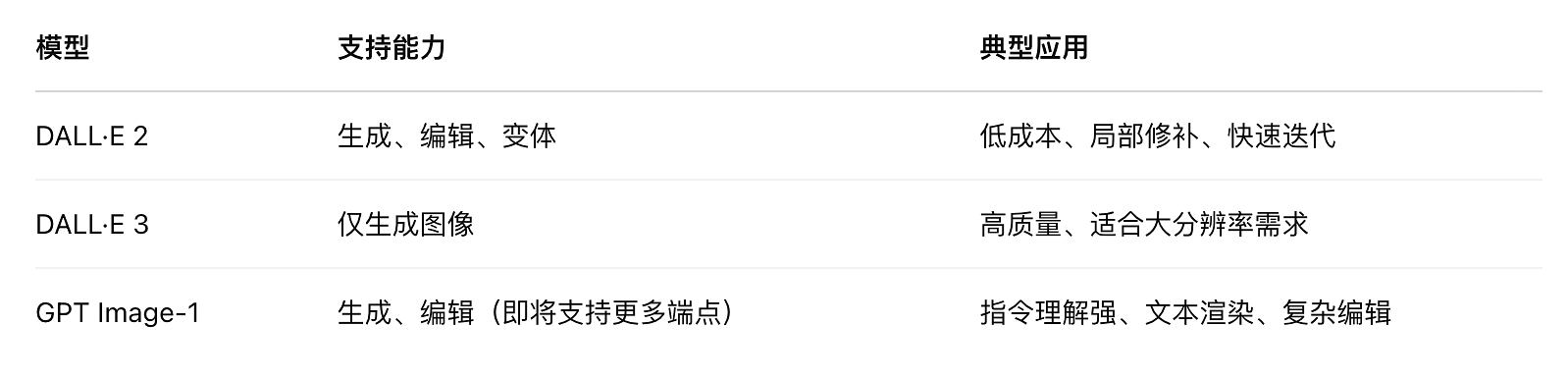

5. gpt-image-1 vs. DALL-E 3/2:关键差异分析

为了帮助开发者更好地理解 gpt-image-1 的定位和优势,有必要将其与 OpenAI 之前提供的图像生成 API 模型 DALL-E 3 和 DALL-E 2 进行比较 。

gpt-image-1****:核心优势: 提供最高的图像质量、最强的指令遵循能力、卓越的文本渲染效果、以及包括图像修复和多图参考在内的详细编辑功能 。支持生成透明背景图像,并能有效利用其内置的世界知识 。

架构: 原生多模态大型语言模型 。

API 端点: 支持

/images/generations和/images/edits。

DALL-E 3 (API):

核心优势: 相较于 DALL-E 2 提供更高的图像质量,支持生成更大分辨率的图像,尤其擅长处理包含较多文本元素的图像 。

架构: 专门的图像生成模型。

API 端点: 仅支持

/images/generations端点,不提供 API 层面的编辑或变体生成功能 。使用体验: 在 ChatGPT 产品中,DALL-E 3 的优异表现部分归功于 ChatGPT 在调用模型前进行的复杂内部提示词重写和优化 。这意味着直接使用 DALL-E 3 API 可能需要开发者自行进行类似的提示工程才能达到最佳效果。相比之下,

gpt-image-1作为原生多模态模型,其固有的强大指令遵循能力和上下文理解能力 ,可能使其在 API 调用时更直接地达到高质量输出,减少了开发者进行复杂外部提示工程的需求。

DALL-E 2 (API):

核心优势: 成本相对较低,支持快速并发请求 。

架构: 专门的图像生成模型。

API 端点: 支持

/images/generations,/images/edits(包括图像修复), 以及/images/variations(生成图像变体) 三个端点 。局限性: 图像质量和指令遵循能力普遍低于 DALL-E 3 和

gpt-image-1。

下表总结了这三个模型在 API 层面的关键特性对比:

| 特性/能力 | gpt-image-1 | DALL-E 3 (API) | DALL-E 2 (API) |

|---|---|---|---|

| 模型架构 | 原生多模态大语言模型 | 专门图像生成模型 | 专门图像生成模型 |

| 支持的 API 端点 | Generations, Edits | Generations Only | Generations, Edits, Variations |

| 图像质量 | 最高 | 高 (优于 DALL-E 2) | 较低 |

| 指令遵循能力 | 最强 | 较强 | 一般 |

| 文本渲染 | 优越 | 较好 (优于 DALL-E 2),擅长文本图像 | 较弱 |

| 编辑能力 (API) | 图像修复 (Inpainting), 多图参考 | 不支持 | 图像修复 (Inpainting) |

| 变体生成 (API) | 不支持 | 不支持 | 支持 |

| 透明背景支持 (API) | 支持 (PNG/WebP) | 未明确提及 (可能不支持) | 未明确提及 (可能不支持) |

| 世界知识利用 | 强 | 有限 | 有限 |

| 成本层级 (相对) | 最高 | 中等 | 最低 |

| 关键优势 | 最高质量, 精细指令遵循, 透明背景, 详细编辑能力 | 更大分辨率 (相对 D2), 文本图像 | 低成本, 快速并发请求, 支持变体生成 |

注意: 此表基于提供的研究材料进行总结,具体细节可能随 OpenAI 的更新而变化。

6. 开发者指南:OpenAI API Key 获取、访问、集成与定价

开发者若想利用 gpt-image-1 的强大功能,需要了解其访问方式、集成方法以及相关的成本结构。

API 访问与端点:

gpt-image-1通过 OpenAI 的标准 REST API 提供服务 。图像生成主要通过向

https://api.openai.com/v1/images/generations端点发送 POST 请求实现 。图像编辑则通过向

https://api.openai.com/v1/images/edits端点发送 POST 请求完成 。需要注意的是,用于生成图像变体的

/images/variations端点不支持gpt-image-1模型,该功能目前仅限于 DALL-E 2 。OpenAI 计划将图像生成能力整合进其

Responses API。Responses API设计用于创建有状态的、类似对话的交互 。将图像生成融入其中,意味着未来开发者或许能够构建更复杂的应用,让模型在持续的对话流中根据上下文生成或编辑图像,而不仅仅是处理孤立的请求。这将为实现动态叙事、协作设计等更高级的多模态交互应用铺平道路。

认证与 SDK:

API 调用采用标准的 API 密钥认证方式,通过在 HTTP 请求头中包含

Authorization: Bearer {YOUR_API_KEY}来实现 。OpenAI 提供了多种语言的官方 SDK(软件开发工具包)以简化集成过程,例如 Python SDK 的使用示例在多个文档中均有提及 。

以下是在uiuiapi 获取的gpt-image-1 api key调用使用案列;

OpenAI API KEY获取新版 gpt-image-1 模型通过 API 进行对话与代码示例

关键点说明

- API连接:

- 以下模型版本都可使用UIUI API的OpenAI兼容接口(

https://sg.uiuiapi.com/v1/images/generations) - 支持二种模型:

gpt-image-1、gpt-image-1-vip

- 以下模型版本都可使用UIUI API的OpenAI兼容接口(

注意事项:

- 用户需要在UIUI API Token页面](https://sg.uiuiapi.com/token)创建自己的API Token

调用OpenAI gpt-image基础文本对话代码示例 ✅

生成图像

你可以使用 图像生成端点 ,基于文本提示创建图像。了解如何自定义输出(尺寸、质量、格式、透明度)可参见下方的自定义图像输出章节。

你可以设置 n 参数,在一次请求中生成多张图片(默认只返回一张图片)。

import OpenAI from "openai";

import fs from "fs";

const openai = new OpenAI();

const prompt = `

A children's book drawing of a veterinarian using a stethoscope to

listen to the heartbeat of a baby otter.

`;

const result = await openai.images.generate({

model: "gpt-image-1",

prompt,

});

// 保存图片到文件

const image_base64 = result.data[0].b64_json;

const image_bytes = Buffer.from(image_base64, "base64");

fs.writeFileSync("otter.png", image_bytes);

from openai import OpenAI

import base64

client = OpenAI()

prompt = """

A children's book drawing of a veterinarian using a stethoscope to

listen to the heartbeat of a baby otter.

"""

result = client.images.generate(

model="gpt-image-1",

prompt=prompt

)

image_base64 = result.data[0].b64_json

image_bytes = base64.b64decode(image_base64)

# 保存图片到文件

with open("otter.png", "wb") as f:

f.write(image_bytes)

curl -X POST "https://api.openai.com/v1/images/generations" \

# 或是在uiuiapi.com 获取 api key 以上地址就换成uiuiapi地址

-H "Authorization: Bearer $OPENAI_API_KEY" \

-H "Content-type: application/json" \

-d '{

"model": "gpt-image-1",

"prompt": "A childrens book drawing of a veterinarian using a stethoscope to listen to the heartbeat of a baby otter."

}' | jq -r '.data[0].b64_json' | base64 --decode > otter.png

编辑图像

图像编辑端点 可用于:

- 编辑已有图像

- 利用其他图片作为参考生成新图像

- 通过上传图像和掩码,仅替换部分区域(即修补/inpainting)

使用参考图像生成新图

你可以用一张或多张图片作为参考,生成新图片。

本例中我们用 4 张输入图片生成一个包含所有物品的礼品篮新图像。

import base64

from openai import OpenAI

client = OpenAI()

prompt = """

Generate a photorealistic image of a gift basket on a white background

labeled 'Relax & Unwind' with a ribbon and handwriting-like font,

containing all the items in the reference pictures.

"""

result = client.images.edit(

model="gpt-image-1",

image=[

open("body-lotion.png", "rb"),

open("bath-bomb.png", "rb"),

open("incense-kit.png", "rb"),

open("soap.png", "rb"),

],

prompt=prompt

)

image_base64 = result.data[0].b64_json

image_bytes = base64.b64decode(image_base64)

# 保存图片到文件

with open("gift-basket.png", "wb") as f:

f.write(image_bytes)

import fs from "fs";

import OpenAI, { toFile } from "openai";

const client = new OpenAI();

const imageFiles = [

"bath-bomb.png",

"body-lotion.png",

"incense-kit.png",

"soap.png",

];

const images = await Promise.all(

imageFiles.map(

async (file) =>

await toFile(fs.createReadStream(file), null, {

type: "image/png",

}),

),

);

const rsp = await client.images.edit({

model: "gpt-image-1",

image: images,

prompt: "Create a lovely gift basket with these four items in it",

});

// 保存图片到文件

const image_base64 = rsp.data[0].b64_json;

const image_bytes = Buffer.from(image_base64, "base64");

fs.writeFileSync("basket.png", image_bytes);

curl -s -D >(grep -i x-request-id >&2) \

-o >(jq -r '.data[0].b64_json' | base64 --decode > gift-basket.png) \

-X POST "https://api.openai.com/v1/images/edits" \

# 或是在 uiuiapi.com 获取 api key 以上地址就换成uiuiapi地址

-H "Authorization: Bearer $OPENAI_API_KEY" \

-F "model=gpt-image-1" \

-F "image[]=@body-lotion.png" \

-F "image[]=@bath-bomb.png" \

-F "image[]=@incense-kit.png" \

-F "image[]=@soap.png" \

-F 'prompt=Generate a photorealistic image of a gift basket on a white background labeled "Relax & Unwind" with a ribbon and handwriting-like font, containing all the items in the reference pictures'

使用掩码编辑图片(修补)

你可以提供掩码,指定图片哪些区域需要编辑。掩码的透明区域将被替换,黑色区域则保持不变。

你可以用提示描述整个新图像,不只限于被擦除的区域。如果提供多张输入图像,掩码会应用于第一张图片。

from openai import OpenAI

client = OpenAI()

result = client.images.edit(

model="gpt-image-1",

image=open("sunlit_lounge.png", "rb"),

mask=open("mask.png", "rb"),

prompt="A sunlit indoor lounge area with a pool containing a flamingo"

)

image_base64 = result.data[0].b64_json

image_bytes = base64.b64decode(image_base64)

# 保存图片到文件

with open("composition.png", "wb") as f:

f.write(image_bytes)

import fs from "fs";

import OpenAI, { toFile } from "openai";

const client = new OpenAI();

const rsp = await client.images.edit({

model: "gpt-image-1",

image: await toFile(fs.createReadStream("sunlit_lounge.png"), null, {

type: "image/png",

}),

mask: await toFile(fs.createReadStream("mask.png"), null, {

type: "image/png",

}),

prompt: "A sunlit indoor lounge area with a pool containing a flamingo",

});

// 保存图片到文件

const image_base64 = rsp.data[0].b64_json;

const image_bytes = Buffer.from(image_base64, "base64");

fs.writeFileSync("lounge.png", image_bytes);

curl -s -D >(grep -i x-request-id >&2) \

-o >(jq -r '.data[0].b64_json' | base64 --decode > lounge.png) \

-X POST "https://api.openai.com/v1/images/edits" \

# 或是在uiuiapi.com 获取 api key 以上地址就换成uiuiapi地址

-H "Authorization: Bearer $OPENAI_API_KEY" \

-F "model=gpt-image-1" \

-F "mask=@mask.png" \

-F "image[]=@sunlit_lounge.png" \

-F 'prompt=A sunlit indoor lounge area with a pool containing a flamingo'

掩码要求

待编辑图片和掩码需为相同格式和尺寸(小于 25MB)。

掩码图片还必须包含 alpha 通道。如果用图片编辑工具创建掩码,请确保保存时包含 alpha 通道。

为黑白掩码添加 alpha 通道

你可以用程序方式给黑白掩码添加 alpha 通道。

为黑白掩码添加 alpha 通道

from PIL import Image

from io import BytesIO

# 1. 加载黑白掩码为灰度图

mask = Image.open(img_path_mask).convert("L")

# 2. 转为 RGBA,以便有 alpha 通道

mask_rgba = mask.convert("RGBA")

# 3. 用掩码本身填充 alpha 通道

mask_rgba.putalpha(mask)

# 4. 转换为字节

buf = BytesIO()

mask_rgba.save(buf, format="PNG")

mask_bytes = buf.getvalue()

# 5. 保存结果文件

img_path_mask_alpha = "mask_alpha.png"

with open(img_path_mask_alpha, "wb") as f:

f.write(mask_bytes)

自定义图像输出

你可以配置如下输出选项:

- 尺寸:图像分辨率(如 1024x1024、1024x1536 等)

- 质量:渲染质量(如 low、medium、high)

- 格式:文件输出格式

- 压缩率:JPEG 和 WebP 格式下的压缩级别(0-100%)

- 背景:透明或不透明

尺寸和质量选项

正方形且标准质量的图片生成速度最快。默认尺寸为 1024x1024 像素。

输出格式

Image API 返回 base64 编码的图像数据。默认格式为 png,也可指定 jpeg 或 webp。

如果使用 jpeg 或 webp,还可通过 output_compression 参数控制压缩级别(0-100%)。比如 output_compression=50 表示压缩 50%。

透明度

gpt-image-1 模型支持透明背景。设置 background 参数为 transparent 即可。

仅 png 和 webp 格式支持透明背景。

透明度建议搭配 medium 或 high 质量使用。

生成透明背景图像示例

import OpenAI from "openai";

import fs from "fs";

const openai = new OpenAI();

const result = await openai.images.generate({

model: "gpt-image-1",

prompt: "Draw a 2D pixel art style sprite sheet of a tabby gray cat",

size: "1024x1024",

background: "transparent",

quality: "high",

});

// 保存图片到文件

const image_base64 = result.data[0].b64_json;

const image_bytes = Buffer.from(image_base64, "base64");

fs.writeFileSync("sprite.png", image_bytes);

from openai import OpenAI

import base64

client = OpenAI()

result = client.images.generate(

model="gpt-image-1",

prompt="Draw a 2D pixel art style sprite sheet of a tabby gray cat",

size="1024x1024",

background="transparent",

quality="high",

)

image_base64 = result.json()["data"][0]["b64_json"]

image_bytes = base64.b64decode(image_base64)

# 保存图片到文件

with open("sprite.png", "wb") as f:

f.write(image_bytes)

curl -X POST "https://api.openai.com/v1/images" \

# 或是在uiuiapi.com 获取 api key 以上地址就换成uiuiapi地址

-H "Authorization: Bearer $OPENAI_API_KEY" \

-H "Content-type: application/json" \

-d '{

"prompt": "Draw a 2D pixel art style sprite sheet of a tabby gray cat",

"quality": "high",

"size": "1024x1024",

"background": "transparent"

}' | jq -r 'data[0].b64_json' | base64 --decode > sprite.png

限制

GPT-4o 图像模型是一款强大且多功能的图像生成模型,但仍需注意以下局限:

- 延迟:复杂提示可能需要最多 2 分钟处理。

- 文本渲染:虽较 DALL·E 系列大幅提升,但在精确文字排版和清晰度方面仍有一定难度。

- 一致性:模型有能力保持图像一致性,但多次生成同一角色或品牌元素时,偶尔仍会出现不一致。

- 构图控制:尽管指令理解已提升,模型在元素精准布局、结构化或版式敏感的图像生成上有时仍有困难。

内容审核

所有提示与生成图像都将根据我们的内容政策进行过滤。

使用 gpt-image-1 生成图像时,可以通过 moderation 参数控制审核严格度。支持以下两种取值:

- auto(默认):标准过滤,限制生成某些潜在不适宜内容。

- low:限制更少。

费用与延迟

本模型通过先生成专用图像 token 再渲染图片。图片尺寸越大、质量越高,token 数量越多,生成时延与成本也越高。

token 数取决于图像尺寸和质量:

此外还需计算提示文本使用的 输入 token。

详细价格信息可参考 价格页面。

定价结构:

gpt-image-1的使用成本基于 token 数量计算,并区分了不同类型的 token 。- 文本输入 token (提示词): 每 1 百万 token 收费 $5 美元。

- 图像输入 token (用于编辑或参考的图像): 每 1 百万 token 收费 $10 美元。

- 图像输出 token (生成的图像): 每 1 百万 token 收费 $40 美元。

这种定价结构清晰地反映了不同操作的计算成本差异。图像生成(输出)的定价远高于图像输入和文本输入,这表明生成过程是计算资源消耗最大的环节。这种成本结构可能会引导开发者更倾向于利用模型的图像分析或编辑能力(输入成本较低),或者需要更仔细地设计提示词以减少昂贵的重复生成次数,尤其对于成本敏感的应用而言 。

根据 OpenAI 提供的示例换算,一张 1024x1024 的方形图像,其生成成本大致为:低质量约 $0.02,中等质量约 $0.07,高质量约 $0.19 。另有信息指出,低质量方形图像消耗 272 token,而高质量竖向图像则消耗 6,240 token ,开发者可据此估算具体成本。

图像 Token 计算:

图像输入的 token 数量并非直接基于像素点,而是根据其尺寸,通过计算覆盖图像所需的 32x32 像素“补丁”(patch) 数量来确定 。

如果所需的补丁数量超过 1536 个 token 的预算上限,图像会被按比例缩小,以确保其能被不超过 1536 个补丁覆盖,同时保持原始宽高比 。

最终用于计费的 token 数即为调整后的补丁数量,单个输入图像的 token 上限为 1536 个 。

这种基于补丁和缩放的复杂计算方式,一方面体现了后端为高效处理不同尺寸图像所做的努力,另一方面也给开发者预估成本带来了一定的复杂性 。它不像文本 token 那样直观,开发者可能需要依赖官方提供的计价器或深入理解计算规则才能准确规划预算和进行优化。

访问要求与潜在问题:

组织验证: 使用

gpt-image-1API 可能需要先完成 OpenAI 的组织验证流程 。初期访问问题: 在 API 发布初期,社区中有大量用户报告遇到了访问问题,包括陷入组织验证循环、验证成功后 API 权限未能及时生效、API 密钥缓存问题(需要生成新密钥才能解决)、遇到预期之外的速率限制错误、模型未在可用列表中显示等 。甚至有用户报告因地理区域限制而无法访问 (HTTP 403 错误) 。

这些广泛存在的初期访问障碍,特别是围绕强制性组织验证流程的技术故障和延迟 ,凸显了在推出具有更高能力和更严格访问控制的新模型时所面临的运营挑战。这不仅给早期采用者带来了不便和挫败感,也可能在一定程度上影响了开发者社区的初步信任和模型的早期采用速度,并暗示了 OpenAI 在为强大新模型设置门槛时可能面临的扩展性问题 。

速率限制: API 的使用受到速率限制,通常以每分钟处理的 token 数 (TPM) 来衡量。但针对

gpt-image-1的具体速率限制数值在所提供的材料中并未明确说明 。开发者可能需要查阅最新的官方文档或定价页面的常见问题解答。作为参考,旧版 DALL-E 的速率限制曾被提及 。

7. 赋能行业:应用场景与合作伙伴集成

gpt-image-1 API 的发布,凭借其高质量的生成能力、强大的编辑功能和对复杂指令的理解力,为各行各业的应用创新注入了新的活力 。

OpenAI 重点展示了一系列早期合作伙伴如何将 gpt-image-1 集成到他们的产品和服务中,这些案例生动地说明了该 API 的广泛适用性 :

创意设计工具:

- Adobe: 在其旗舰产品 Firefly 和 Express 中探索集成,让创作者能够尝试不同美学风格,激发新的创意灵感。

- Figma: 将图像生成和编辑功能直接嵌入 Figma 设计画布,用户可以快速生成、调整样式、增删对象、扩展背景,加速设计迭代。

- Canva: 探索利用

gpt-image-1突破设计生成和编辑的界限,例如将草图转化为精美的图形元素,或进行高保真的视觉编辑,赋能其庞大的用户群体。 - Playground: 让用户能够对其设计进行更强大的编辑,如改变风格、颜色,以及将设计置入更高保真度的模型(mockups)中。

企业与营销:

- Airtable: 帮助企业团队大规模管理资产工作流,从生成营销活动概念到为国际市场重新混合和本地化媒体内容。

- HubSpot: 探索如何帮助客户轻松创建用于社交媒体、电子邮件营销和登陆页的高质量图像,即使没有专业设计技能。

- GoDaddy: 试验集成图像生成功能,帮助客户轻松创建可编辑的 Logo、移除背景、生成专业字体,并计划扩展到创建符合品牌形象的社交媒体帖子和营销素材。

内容创作与媒体:

- OpusClip Thumbnail: 利用

gpt-image-1帮助 YouTube 创作者生成与视频内容和标题高度匹配、优化点击率的个性化缩略图。 - invideo: 集成

gpt-image-1以提供改进的文本生成、精细的编辑控制和高级风格指导,帮助用户将想法转化为视频。

- OpusClip Thumbnail: 利用

电子商务:

- Photoroom: 推出基于

gpt-image-1的三款新 AI 工具(产品美化器、产品场景生成器、虚拟模特),帮助在线卖家仅凭一张产品照片就能即时创建影棚级视觉效果、生活方式场景图和模特上身图,极大地提高了内容创作效率 。

- Photoroom: 推出基于

演示与协作:

- Gamma: 使用

gpt-image-1生成详细的图表和可视化内容,编辑现有图像,并统一图像风格,以创建外观一致的演示文稿和网站。

- Gamma: 使用

平台与社区:

- Quora: 将

gpt-image-1设为其平台新的默认图像模型,旨在提升其数百万用户和创作者社区的图像生成质量和指令遵循标准。 - Wix: 在其 Wixel 平台中集成了图像生成功能,用户可以轻松将想法转化为专业级设计,并能通过微调提示词、替换/移除对象、添加滤镜等方式进行编辑。

- Quora: 将

虚拟形象与个性化:

- HeyGen: 集成该模型以增强虚拟形象的创建和编辑体验,提升平台内的个性化定制能力。

消费应用:

- Instacart: 测试使用 API 生成食谱图片和购物清单图片等新方式。

这些合作伙伴覆盖了从专业创意软件到企业营销平台,再到内容创作辅助工具和面向消费者的应用等多个领域。这种广泛的合作布局 清晰地表明,OpenAI 的目标是让 gpt-image-1 成为跨越众多行业的底层视觉生成引擎,而不仅仅是服务于少数专业领域的利基工具。它旨在将 AI 驱动的视觉能力深度融入数字经济的各个环节,包括商业工作流、生产力工具、消费者体验和专业创作流程。

除了已公布的合作案例,gpt-image-1 的潜力还延伸到更广泛的领域,例如:构建能够生成视觉内容以辅助交互的 AI 助手和智能体;为游戏和扩展现实 (XR) 应用快速生成环境、纹理或概念艺术,加速原型设计和迭代开发;按需生成科学图解、历史场景复原或数据可视化图表,用于教育和知识传播等 。

8. 安全、责任与溯源

在推出功能强大的 gpt-image-1 API 的同时,OpenAI 也强调了其在安全、负责任使用方面的考量和措施 。

安全护栏与基础设施:

gpt-image-1API 利用了与 ChatGPT 中 GPT-4o 图像生成功能相同的安全基础设施和防护措施,旨在限制生成有害或违反政策的图像 。这些措施建立在 OpenAI 从部署 DALL-E 和 Sora 等早期模型中吸取的经验教训之上 。内容过滤: 所有通过 API 发送的图像生成请求都会经过 OpenAI 内容策略的过滤 。如果请求被判定为违反政策,API 将返回错误而不是生成图像 。

可控的审核强度: OpenAI 为开发者提供了一定的灵活性,允许通过 API 参数 (

moderation) 来调整内容审核的严格程度 。除了默认的"auto"级别外,开发者可以选择更宽松 ("low") 或更严格 ("strict") 的过滤级别(具体选项请参考最新文档)。这种设计承认了不同应用场景可能具有不同的风险承受能力和内容需求,允许开发者在安全性和创作自由度之间做出一定权衡,当然,所有操作仍需在 OpenAI 的整体使用政策框架内进行 。内容出处与透明度 (C2PA): 为了提高透明度并帮助打击潜在的滥用(如虚假信息传播),通过

gpt-image-1API 生成的图像默认会嵌入 C2PA (Coalition for Content Provenance and Authenticity) 元数据 。C2PA 是一种技术标准,它允许在数字内容中嵌入关于其来源和历史的可验证信息,类似于一个数字“成分标签”。对于gpt-image-1生成的图像,这些元数据可以表明该图像是由 AI 生成的,并可能包含生成工具(OpenAI 模型)等信息 。这种主动采用 C2PA 标准的做法,反映了 OpenAI 对其强大图像生成技术可能带来的社会风险(尤其是误传信息)的认识,并试图通过建立行业认可的出处追踪机制来应对。这不仅有助于用户和平台识别 AI 生成内容,也可能对其他 AI 模型提供商在内容溯源方面起到示范作用 。数据使用政策: OpenAI 明确表示,默认情况下不会使用客户通过 API 提交的数据来训练其模型 。所有 API 的使用仍需遵守 OpenAI 的使用政策 。

9. 市场意义与未来展望

gpt-image-1 API 的发布,不仅是 OpenAI 产品线的一次重要扩展,更对整个 AI 图像生成领域乃至更广泛的技术生态产生了深远的影响。

技术普及与能力提升: 此举将原先主要局限于 ChatGPT 产品内部的、代表业界顶尖水平的原生多模态图像生成能力,正式开放给广大开发者 。这极大地降低了开发者获取和集成最先进图像生成技术的门槛。凭借其在高保真度、指令遵循、文本渲染和编辑方面的综合优势,

gpt-image-1有潜力成为市场上领先的图像生成 API 解决方案之一(有评论甚至称其为“世界最强” )。原生多模态的价值:

gpt-image-1被反复强调为“原生多模态”模型,并“深度嵌入”在 GPT-4o 的架构中 。这暗示其并非简单地将独立的文本模型和图像模型连接起来,而是在一个统一的架构内处理和理解多种模态。这种架构上的统一性,很可能是其在理解复杂指令、保持上下文连贯性(如多轮对话式生成)、以及融合文本和图像知识方面表现出色的关键原因 。将这种先进的统一多模态架构通过 API 提供出来,使得开发者能够构建出在语言理解和视觉创作/编辑之间结合更紧密、交互更自然的应用程序。OpenAI 平台战略的一部分:

gpt-image-1的发布并非孤立事件,它发生在 OpenAI 密集更新其 API 产品组合的时期。几乎在同一时间段内,OpenAI 还发布了性能更强的语言模型(如 GPT-4.1 系列、o3、o4-mini)、用于构建更复杂交互的 Responses API、以及面向智能体(Agent)开发的工具集(如 Agents SDK、网页搜索、文件搜索、计算机使用工具等)。这一系列动作表明,gpt-image-1是 OpenAI 更宏大平台战略的一部分,旨在全面提升其开发者平台的能力,特别是朝着更强的推理、更深入的多模态融合以及更自主的智能体系统方向发展。gpt-image-1在其中扮演了提供核心视觉生成与编辑能力的关键角色,与其他新发布的组件共同赋能开发者构建远比以往更复杂、更强大的多模态应用和自主系统 。未来展望:

gpt-image-1API 的推出预计将对创意产业、设计工作流、内容营销、个性化定制等领域产生变革性影响 。随着开发者社区的探索和应用,可能会涌现出许多基于该 API 的创新工具和服务。未来,随着图像生成能力与 Responses API 的深度整合 ,我们有望看到更加流畅、自然的对话式图像创作和编辑体验成为现实,进一步推动多模态人机交互的发展。

10. 结论

OpenAI gpt-image-1 API 的发布是 AI 图像生成领域的一个重要进展。它首次将基于 GPT-4o 的、业界领先的原生多模态图像生成能力开放给开发者,提供了前所未有的图像质量、指令遵循精度、文本渲染效果和高级编辑功能。相较于 OpenAI 先前的 API 产品(如 DALL-E 3 和 DALL-E 2),gpt-image-1 在综合能力上实现了显著的飞跃。

该 API 的推出为各行各业的开发者提供了强大的新工具,有望催生出大量创新的应用和工作流程,从自动化营销素材生成到交互式设计辅助,再到更智能的多模态 AI 代理。其原生多模态架构和对复杂指令的深刻理解,预示着未来人机交互中视觉内容生成将扮演更加核心和无缝的角色。

然而,开发者在使用 gpt-image-1 时也需考虑其相对较高的成本结构,关注并应对模型在角色一致性等方面的潜在局限性,并留意初期可能存在的访问和稳定性问题。同时,负责任地使用这项强大技术至关重要。OpenAI 通过内置的安全护栏、可控的审核级别以及默认嵌入 C2PA 元数据等措施,展现了其对安全和内容溯源的重视,开发者也应积极配合,确保技术的健康发展和应用。

总而言之,gpt-image-1 API 不仅是 OpenAI 技术实力的展示,更是其推动多模态 AI 平台化、赋能开发者生态战略的关键一步。它的出现,连同 OpenAI 近期发布的一系列其他先进模型和工具,共同描绘了一个更加智能、更加交互、更加多模态的 AI 应用未来。

暂无评论,3272人围观